边缘计算到底是什么?一句话:把计算、存储、 *** 能力下沉到离数据源最近的“边缘节点”,让数据在本地就能被处理,而不是全部涌向云端。

边缘计算与云计算的差异:为什么需要“下沉”?

传统云计算模型强调“集中式”,所有终端产生的数据都要先上传到云中心,再返回结果。这种模式在以下场景会遇到瓶颈:

- 高时延:远程医疗、自动驾驶要求毫秒级响应,云端往返无法满足。

- 带宽瓶颈:百万级摄像头同时推流,骨干网瞬间被挤爆。

- 数据 *** :金融、政务数据不能离境,必须本地闭环。

边缘计算把算力“推”到基站、路由器、工业网关甚至终端芯片里,实现本地预处理、本地决策、本地存储,仅把必要结果回传云端。

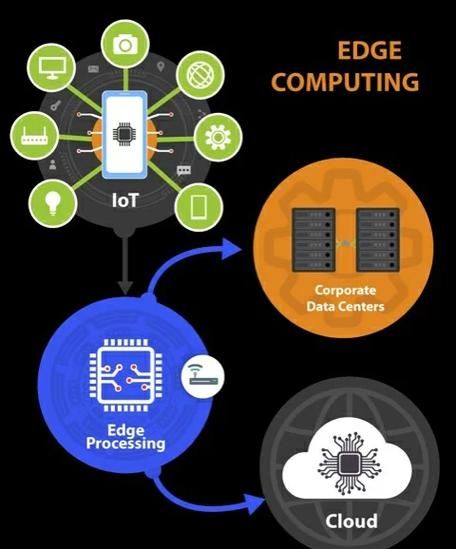

边缘计算如何重塑物联网架构?

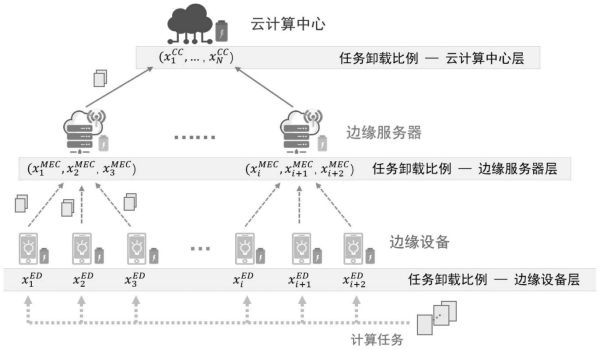

1. 分层拓扑:从“云-端”到“云-边-端”

过去物联网只有两层:终端→云。现在变成三层:

- 终端层:传感器、摄像头、PLC,负责原始数据采集。

- 边缘层:边缘网关、边缘服务器,完成协议转换、数据清洗、AI推理。

- 云层:负责全局策略、模型训练、长期归档。

这种分层让90%的冗余数据在边缘就被过滤,真正上云的数据量下降一个数量级。

2. 实时闭环:毫秒级控制成为可能

以智能工厂为例:

- 机械臂的视觉检测算法跑在产线边缘盒子上,检测延迟从200ms降到10ms。

- 一旦发现次品,边缘节点立即下发停机指令,避免整批报废。

边缘计算的关键技术栈拆解

硬件:从x86到ARM再到RISC-V

边缘节点形态多样,芯片选择也呈“三足鼎立”:

- x86:性能高,适合重负载AI推理,但功耗大。

- ARM:能效比优,广泛用于智能网关、车载域控。

- RISC-V:开源指令集,可定制安全模块,满足国密场景。

软件:轻量级容器与Serverless并存

边缘资源有限,传统虚拟机太重,因此出现两大技术路线:

- 容器化:K3s、MicroK8s把Kubernetes裁剪到100MB以内,支持离线自治。

- Serverless:OpenYurt、Knative Edge让函数在离最近节点冷启动,内存占用低至32MB。

*** :5G uRLLC与TSN双轮驱动

5G的uRLLC(超可靠低时延通信)把空口时延压到1ms,而TSN(时间敏感 *** )让以太网具备确定性,二者叠加实现端到端抖动<10μs,满足运动控制场景。

边缘计算落地的三大挑战

1. 安全:分布式攻击面指数级扩大

边缘节点散落在工厂、街道、甚至野外,物理安全难以保障。解决方案:

- 零信任架构:每次访问都动态鉴权,不再默认“内网可信”。

- 可信执行环境(TEE):在CPU内部开辟安全飞地,即使主机被攻破,密钥也无法被窃取。

2. 运维:百万节点如何“自动驾驶”?

传统人工运维已不可行,必须依赖:

- 数字孪生:为每个边缘节点构建虚拟镜像,实时映射温度、CPU、链路质量。

- AIOps:通过异常检测算法提前预测硬盘故障,宕机率降低60%。

3. 标准:碎片化生态呼唤统一API

目前边缘市场存在ETSI MEC、OpenFog、EdgeX Foundry等十余种框架,应用迁移成本高。Linux基金会推出的LF Edge正试图整合接口,定义统一的设备Profile与数据模型。

边缘计算的商业价值:谁在买单?

运营商:从“流量管道”到“算力服务”

中国移动在基站侧部署边缘云,把时延敏感业务(如云游戏、AR导航)打包成MEC套餐,ARPU值提升30%。

制造业:产线改造ROI一年回本

某汽车厂在冲压车间上线边缘质检,减少人工目检岗位,每年节省人力成本800万元,项目回收期仅9个月。

智慧城市:红绿灯也能“思考”

深圳在路口杆站集成边缘AI盒子,实时分析车流与行人轨迹,动态调整信号灯配时,高峰期拥堵指数下降22%。

未来趋势:从“边缘”到“无界计算”

随着6G、卫星互联网、脑机接口的发展,计算将无处不在:

- 空天地一体:无人机、低轨卫星成为“空中边缘节点”,为远洋、沙漠提供毫秒级算力。

- 存算一体芯片:MRAM、ReRAM直接在存储单元内完成矩阵乘加,能效提升100倍。

- 联邦学习:数据不出厂,模型在边缘间协同训练,解决隐私与性能的矛盾。

边缘计算不再是云的“附属品”,而是下一代数字基础设施的“主角”。

评论列表